No paramos de leer acerca de las utilidades de la inteligencia artificial y es que sí, tiene usos legítimos y positivos. Pero no todas las personas que están desarrollando aplicaciones lo hacen con las mejores intenciones. De hecho, se está utilizando para generar deep fakes (contenido alterado por la inteligencia artificial para parecer real).

Las imágenes producidas nos podían parecer intrigantes como cuando vimos la foto del Papa Francisco en una campera de Balenciaga, pero al mismo tiempo las nuevas herramientas están siendo utilizadas exclusivamente para generar imágenes pornográficas falsas de mujeres y niñas que, por supuesto, no han dado su consentimiento.

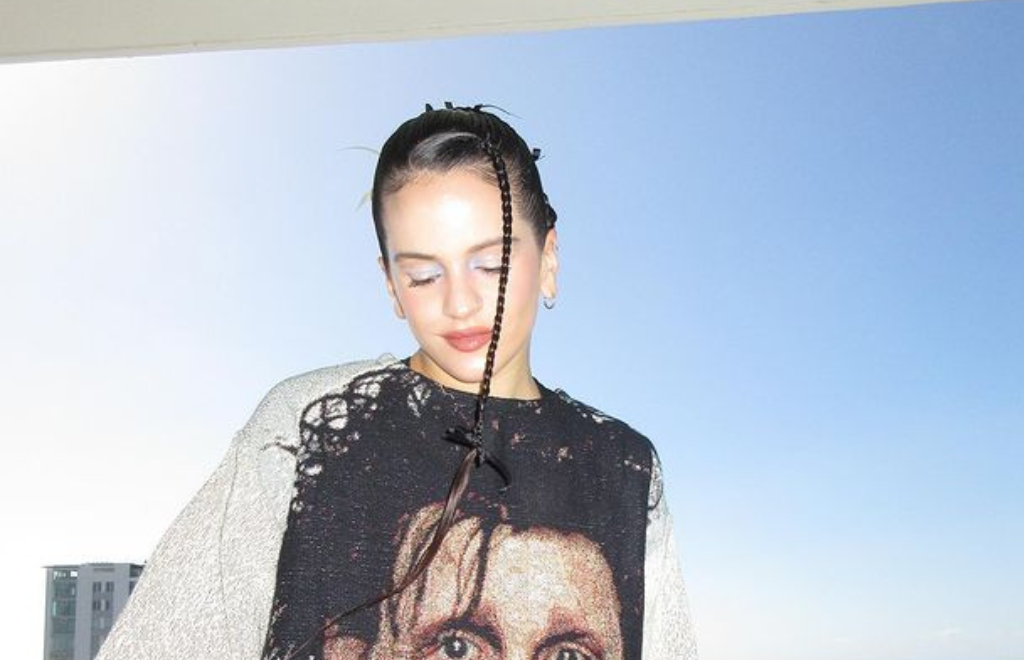

Hace pocos días, el cantante JC Reyes compartió una fotografía falsa de Rosalía haciendo entender que ella misma se la habría enviado y luego aclaró: “es Photoshop”. Los usuarios en redes sociales estallaron en su contra por la evidente violación a la imagen de la cantante. La propia artista compartió su descargo en sus redes sociales:

Ir a buscar clout faltando el respeto y sexualizando a alguien es un tipo d violencia y da asco pero hacerlo por 4 plays de + lo q da es pena

— R O S A L Í A (@rosalia) May 23, 2023

El cuerpo d una mujer n es propiedad pública, no es una mercancía xa tu estrategia d marketing. Esas fotos estaban editadas y creaste una falsa narrativa alrededor cuando ni t conozco. Existe algo llamado consentimiento y todos a los q os pareció gracioso o plausible espero de…

— R O S A L Í A (@rosalia) May 24, 2023

Su descargo y el apoyo que recaudó de la comunidad abrió un debate, ¿por qué Rosalía se queja de que alguien publique una foto falsa de ella desnuda cuando ella publica imágenes mostrando su cuerpo en redes? La respuesta es simple: si una mujer decide publicar una foto suya desnuda es su elección, porque es dueña de su cuerpo. La foto que publicó JC Reyes no sólo es falsa, también es publicada sin el consentimiento de la artista y es un claro ejemplo más de la violencia machista a la que somos sometidas las mujeres en nuestra sociedad.

Usaron mi foto de la playa y con Inteligencia Artificial “me quitaron la ropa”.. estoy harta de ver cómo nos utilizan para su entretenimiento, la foto esta en Grupos de WhatsApp, redes sociales, NO SOY YO y lo más lamentable de todo es que no puedo hacer nada al respecto. pic.twitter.com/Er78wXxkTb

— Johanna Villalobos 🐍 (@johavillam) May 23, 2023

El caso de Rosalía es paradigmático porque ella y quien compartió su foto son figuras públicas, pero no es la única que ha sufrido este tipo de violencia. Otras artistas son víctimas de este tipo de uso de la inteligencia artificial y existen videos de fake porn que usan su imagen en sitios de pornografía. Además, es importante resaltar que esto no afecta solo a celebridades, influencers o personas públicas, sino que tiene el potencial de afectar a cualquier persona.

Para investigar un poco de este fenómeno, busqué información en el principal buscador del mercado, “fake porn” fue mi búsqueda, y los primeros siete links me llevaban a sitios de pornografía. En la información que me ofrecía el buscador acerca de esos links encontré frases como: “El mejor lugar para encontrar porno deep fake de celebridades”, “Mira las mejores imitaciones de celebridades de Hollywood”, o “Podés ver desnudos photoshopeados”. Estas páginas se regodean de ser los mejores sitios para encontrar este tipo de material que atenta contra los derechos que las mujeres deberíamos tener sobre nuestros propios cuerpos y cómo compartirlos.

En algunos países –como Argentina– están vigentes, legislaciones que prohíben la difusión de imágenes privadas sin consentimiento de una mujer, como para el caso del revenge porn, otro fenómeno más de violencia machista en la que se difunden videos o fotos de contenido sexual en la red sin el consentimiento de las personas que aparecen a modo de “venganza”. En el caso de las imágenes generadas con inteligencia artificial, no hay medidas concretas que controlen su creación y difusión, aunque es hora de que se empiecen a discutir.

Por ahora, como ciudadanos tenemos el poder de frenar o, por lo menos, no colaborar con la distribución de este contenido tanto cuando es falso, como cuando es real.